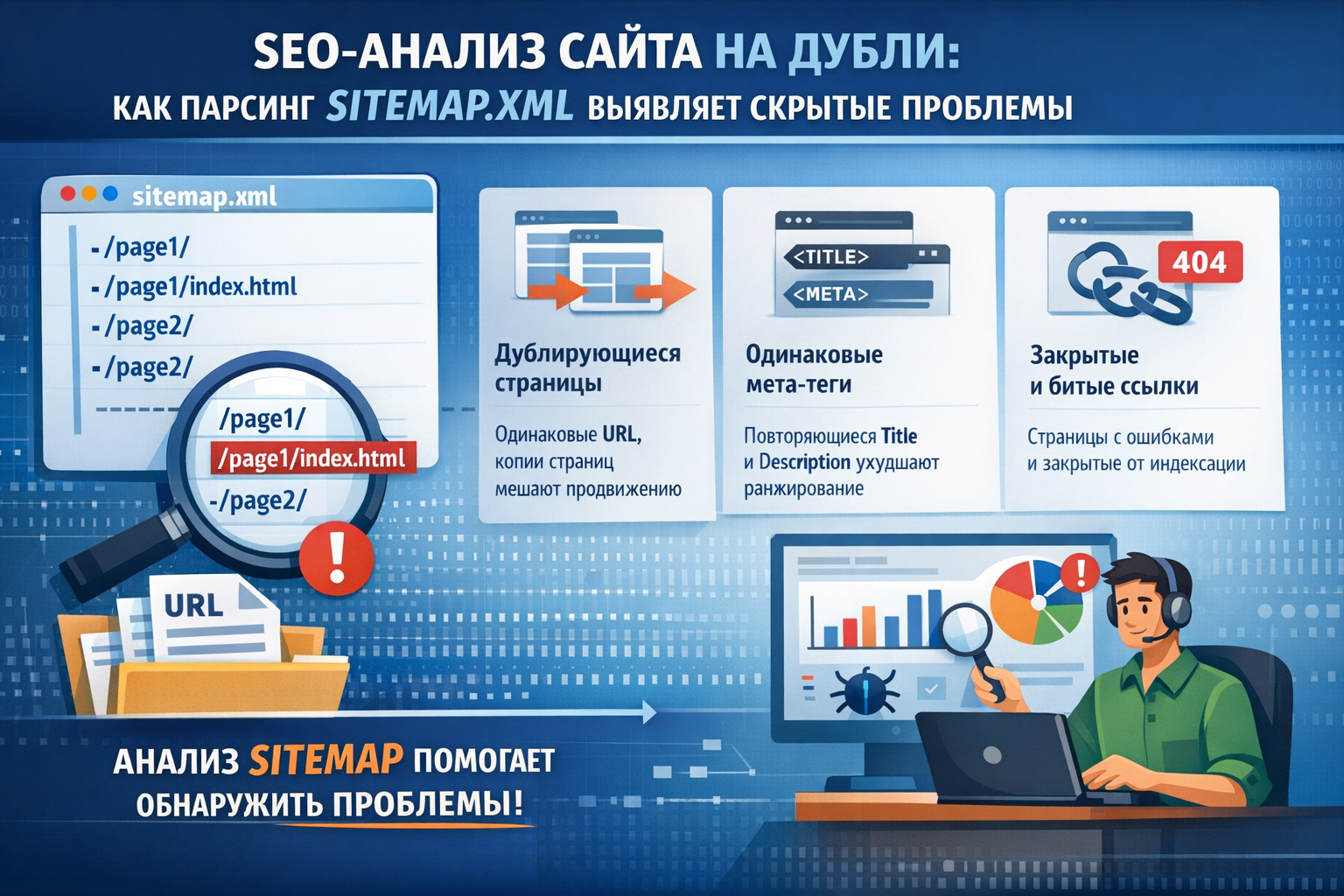

SEO-анализ сайта на дубли: как парсинг sitemap.xml выявляет скрытые проблемы

Содержание

- Введение

- Что такое sitemap.xml и зачем он нужен

- Какие дубли встречаются на сайтах

- Проблемы с hreflang на мультиязычных сайтах

- Битые страницы в карте сайта

- Как парсинг sitemap помогает найти проблемы

- Типичные причины появления дублей

- Практический чек-лист SEO-аудита

- Заключение

- Полный листинг команды аудита

Введение

Дубли на сайте — одна из самых коварных SEO-проблем. Они не вызывают ошибок в браузере, не ломают вёрстку и не мешают пользователям. Но для поисковых систем дублирующийся контент — серьёзный сигнал о низком качестве ресурса. Яндекс и Google могут понизить позиции сайта, если обнаружат одинаковые заголовки, описания или повторяющиеся URL в его структуре.

Карта сайта (sitemap.xml) — это файл, который вы сами отдаёте поисковикам как «путеводитель» по страницам. Если в этом файле есть ошибки, вы буквально направляете роботов к проблемным местам. Парсинг sitemap.xml позволяет автоматически выявить дубли до того, как их обнаружат поисковые системы, и устранить проблемы до потери позиций.

Что такое sitemap.xml и зачем он нужен

Sitemap.xml — это XML-файл, расположенный в корне сайта, который содержит список всех страниц, предназначенных для индексации. Каждая запись включает URL страницы, дату последнего обновления (lastmod), частоту изменений (changefreq) и приоритет (priority).

Поисковые роботы используют этот файл как карту для обхода сайта. Если страница есть в sitemap — робот посетит её в первую очередь. Если страницы нет — она может быть проиндексирована с задержкой или не проиндексирована вовсе.

Именно поэтому качество карты сайта напрямую влияет на SEO-показатели:

- Скорость индексации — новые страницы попадают в поисковую выдачу быстрее

- Полнота охвата — все важные страницы гарантированно видны роботам

- Сигнал доверия — корректная карта говорит поисковикам, что сайт поддерживается и обновляется

Но если карта содержит ошибки — дублирующиеся URL, битые ссылки, некорректные аннотации — эффект оказывается обратным. Робот тратит свой «краулинговый бюджет» на обход одних и тех же страниц, а сайт получает штрафные сигналы.

Какие дубли встречаются на сайтах

При аудите карты сайта необходимо проверять три основных типа дублей. Каждый из них влияет на SEO по-разному, но все они снижают эффективность индексации.

Дубли URL в самой карте сайта

Самый очевидный тип — когда один и тот же адрес страницы встречается в sitemap.xml несколько раз. Это часто происходит, когда карта формируется из нескольких источников: статические страницы добавляются вручную, а динамические — генерируются автоматически из базы данных. В результате страницы вроде /services или /contacts могут попасть в карту дважды.

Поисковый робот обработает оба вхождения, но потратит вдвое больше ресурсов. На крупных сайтах с тысячами страниц это приводит к ощутимой потере краулингового бюджета.

Дубли заголовков <title>

Тег <title> — один из главных факторов ранжирования. Поисковые системы используют его для понимания тематики страницы и формирования сниппета в выдаче. Если несколько страниц имеют одинаковый <title>, поисковик не может отличить их друг от друга и вынужден выбирать, какую из них показать пользователю.

Типичный пример: CMS по умолчанию подставляет название сайта во все заголовки, и разработчик забывает задать уникальные title для каждой страницы. В результате десятки страниц получают заголовок вида «Название компании — Главная».

Дубли <meta description>

Meta description не является прямым фактором ранжирования, но напрямую влияет на кликабельность (CTR) в поисковой выдаче. Одинаковые описания на разных страницах — сигнал для поисковиков, что контент шаблонный или автоматически сгенерированный без должной проработки.

Распространённая ситуация: описание задаётся по умолчанию на уровне шаблона, и если автор не заполнил поле вручную, страница получает общее описание сайта. При аудите такие дубли легко обнаружить — несколько страниц будут иметь одно и то же значение description.

Проблемы с hreflang на мультиязычных сайтах

Для сайтов с несколькими языковыми версиями в sitemap.xml добавляются аннотации hreflang — специальные теги, которые указывают поисковым системам, какая версия страницы предназначена для какого языка. Ошибки в этих аннотациях приводят к тому, что пользователю из России показывается англоязычная страница, а пользователю из США — русскоязычная.

Три наиболее частые проблемы с hreflang:

- Отсутствие обратной ссылки. Если русская страница указывает на английскую как альтернативу, английская версия обязана ссылаться обратно на русскую. Без этой взаимности поисковик игнорирует обе аннотации

- Отсутствие ссылки на себя. По спецификации Google, каждая страница с hreflang-аннотациями должна включать ссылку на саму себя (self-referencing). Без неё вся группа аннотаций считается невалидной

- Ссылка на несуществующую страницу. Hreflang указывает на URL, которого нет в карте сайта или который возвращает ошибку. Робот не может подтвердить связь между языковыми версиями

Обнаружить эти проблемы вручную на сайте с сотнями страниц практически невозможно. Автоматический парсинг sitemap с проверкой hreflang-связей — единственный надёжный способ поддерживать мультиязычный сайт в корректном состоянии.

Битые страницы в карте сайта

Ещё одна критическая проблема — наличие в sitemap.xml страниц, которые возвращают HTTP-код, отличный от 200 OK. Это могут быть удалённые страницы (404), перенаправления (301/302) или серверные ошибки (500).

Когда поисковый робот обнаруживает в карте сайта ссылку на несуществующую страницу, он расценивает это как признак низкого качества обслуживания ресурса. Единичные ошибки не приведут к катастрофе, но систематическое наличие битых ссылок в sitemap снижает доверие поисковика к сайту в целом.

Проверка HTTP-статусов всех URL из карты сайта позволяет:

- Выявить удалённые страницы, которые забыли убрать из sitemap

- Обнаружить «тихие» серверные ошибки, которые не видны обычным посетителям

- Найти цепочки перенаправлений, замедляющие индексацию

Как парсинг sitemap помогает найти проблемы

Ручная проверка карты сайта неэффективна даже для небольших проектов. Сайт с блогом, каталогом услуг и портфолио легко набирает 100-200 страниц, а с мультиязычной версией — вдвое больше. Автоматический парсинг решает эту задачу за секунды.

Алгоритм аудита через парсинг sitemap.xml включает несколько этапов:

- Загрузка и разбор XML. Скрипт скачивает карту сайта и извлекает все записи: URL, даты обновления, приоритеты и hreflang-аннотации

- Проверка на дубли URL. Простой подсчёт вхождений каждого адреса выявляет повторяющиеся записи

- Валидация hreflang. Для каждой языковой аннотации проверяется наличие обратной ссылки, self-referencing и существование целевого URL в карте

- Обход страниц. Скрипт открывает каждый уникальный URL и фиксирует HTTP-статус ответа. Параллельные запросы позволяют обработать сотни страниц за несколько секунд

- Извлечение meta-данных. Из HTML каждой страницы извлекаются теги <title> и <meta description>

- Группировка и поиск дублей. Все полученные заголовки и описания сравниваются между собой. Страницы с одинаковыми значениями группируются и выводятся в отчёт

Результат парсинга — структурированный отчёт, который показывает точное количество проблем по каждой категории и конкретные URL, требующие внимания.

Типичные причины появления дублей

Понимание причин помогает не только исправлять, но и предотвращать появление дублей. Вот наиболее распространённые ситуации:

- Смешение статических и динамических данных. Карта сайта формируется частично вручную (навигационные страницы), частично из базы данных (статьи, кейсы). Если одна и та же страница попадает в оба источника, возникает дубль URL

- Шаблонные meta-теги. CMS или фреймворк подставляет значение по умолчанию для <title> и <meta description>, когда автор не заполнил эти поля. На сайте с сотней статей достаточно нескольких незаполненных карточек, чтобы получить группу дублей

- Массовые обновления базы данных. Автоматические задачи — проверка переводов, SEO-анализ, обновление статусов — изменяют поле «дата обновления» у всех записей. В результате lastmod в карте сайта становится одинаковым для всех страниц, что обесценивает этот сигнал для поисковика

- Некорректная генерация hreflang. При добавлении мультиязычности hreflang-аннотации добавляются только для одной языковой версии (например, английской), а основная (русская) версия остаётся без обратных ссылок

- Забытые удалённые страницы. Страница удалена или снята с публикации, но из карты сайта её не убрали. Такой URL возвращает 404, но продолжает направлять к себе поисковых роботов

Практический чек-лист SEO-аудита

Регулярный аудит карты сайта должен стать частью SEO-рутины. Рекомендуемая периодичность — раз в неделю для активно обновляемых сайтов и раз в месяц для статичных проектов.

Что проверять при каждом аудите:

- Дубли URL — убедитесь, что каждый адрес встречается в sitemap ровно один раз

- HTTP-статусы — все URL из карты должны возвращать код 200. Перенаправления (301) допустимы, но нежелательны

- Уникальность <title> — каждая страница должна иметь собственный заголовок, отражающий её содержание

- Уникальность <meta description> — описания должны быть уникальными и содержательными, а не шаблонными

- Корректность hreflang — все связи между языковыми версиями должны быть взаимными, с self-referencing

- Актуальность lastmod — даты обновления должны отражать реальные изменения контента, а не технические модификации

- Полнота карты — все публичные страницы должны присутствовать в sitemap, включая обе языковые версии

Автоматизация этих проверок — оптимальное решение. Скрипт, запущенный по расписанию, обнаружит проблему в тот же день, когда она появилась, а не через месяц при ручной проверке.

Заключение

SEO-аудит через парсинг sitemap.xml — это не разовая акция, а системный процесс, который должен быть встроен в цикл поддержки сайта. Дубли URL, одинаковые заголовки, шаблонные описания и ошибки hreflang накапливаются незаметно, но их совокупный эффект может стоить сайту десятков позиций в поисковой выдаче.

Автоматический парсинг карты сайта решает три ключевые задачи:

- Скорость — полная проверка сайта из 200 страниц занимает менее минуты

- Полнота — проверяются все типы проблем одновременно: дубли, HTTP-статусы, hreflang, meta-данные

- Регулярность — автоматический запуск по расписанию гарантирует, что ни одна проблема не останется незамеченной

Инвестиция в автоматизацию SEO-аудита окупается многократно: вы тратите время на настройку один раз, а система работает на вас постоянно, защищая позиции сайта и обеспечивая качественную индексацию всех страниц.

Полный листинг команды аудита sitemap на Laravel

Ниже приведён полный исходный код Artisan-команды seo:audit-sitemap, которая реализует все описанные в статье проверки: дубли URL, дубли title и meta description, валидацию hreflang-аннотаций и проверку HTTP-статусов страниц.

<?php

namespace App\Console\Commands;

use Illuminate\Console\Command;

use Illuminate\Http\Client\Pool;

use Illuminate\Http\Client\Response;

use Illuminate\Support\Collection;

use Illuminate\Support\Facades\Http;

class AuditSitemap extends Command

{

protected $signature = 'seo:audit-sitemap

{url : URL of the sitemap.xml to parse}

{--timeout=15 : HTTP request timeout in seconds per page}

{--concurrency=5 : Max concurrent HTTP requests when fetching pages}';

protected $description = 'Parse sitemap.xml and detect duplicate URLs, <title>, <meta description>, broken pages and hreflang issues';

private const XHTML_NS = 'http://www.w3.org/1999/xhtml';

private Collection $brokenPages;

public function handle(): int

{

$this->brokenPages = collect();

$sitemapUrl = $this->argument('url');

$timeout = (int) $this->option('timeout');

$this->info("Fetching sitemap: {$sitemapUrl}");

$entries = $this->parseSitemap($sitemapUrl);

if ($entries === null) {

$this->error('Failed to fetch or parse the sitemap.');

return self::FAILURE;

}

$locs = $entries->pluck('loc');

$this->info("Found {$locs->count()} URL entries in the sitemap.");

$this->newLine();

$duplicateUrls = $locs->countBy()->filter(fn (int $count) => $count > 1);

$this->reportDuplicateUrls($duplicateUrls);

$hreflangIssues = $this->validateHreflang($entries);

$this->reportHreflangIssues($hreflangIssues);

$uniqueUrls = $locs->unique()->values();

$this->info("Fetching {$uniqueUrls->count()} unique pages...");

$pages = $this->fetchPages($uniqueUrls, $timeout);

$this->newLine();

$this->reportBrokenPages();

$duplicateTitles = $this->findDuplicates($pages, 'title');

$this->reportDuplicates($duplicateTitles, 'title');

$duplicateDescriptions = $this->findDuplicates($pages, 'description');

$this->reportDuplicates($duplicateDescriptions, 'meta description');

$this->printSummary($duplicateUrls, $duplicateTitles, $duplicateDescriptions, $hreflangIssues);

$hasIssues = $duplicateUrls->isNotEmpty()

|| $duplicateTitles->isNotEmpty()

|| $duplicateDescriptions->isNotEmpty()

|| $this->brokenPages->isNotEmpty()

|| $hreflangIssues->isNotEmpty();

return $hasIssues ? self::FAILURE : self::SUCCESS;

}

private function parseSitemap(string $url): ?Collection

{

try {

$response = Http::timeout(15)->get($url);

} catch (\Throwable $e) {

$this->error("HTTP error: {$e->getMessage()}");

return null;

}

if ($response->failed()) {

return null;

}

$previousUseErrors = libxml_use_internal_errors(true);

$xml = simplexml_load_string($response->body());

libxml_use_internal_errors($previousUseErrors);

if ($xml === false) {

return null;

}

$nodes = [];

foreach ($xml->url as $node) {

$nodes[] = $node;

}

return collect($nodes)

->map(fn (\SimpleXMLElement $node) => [

'loc' => trim((string) $node->loc),

'hreflang' => $this->parseHreflangLinks($node),

])

->filter(fn (array $entry) => $entry['loc'] !== '')

->values();

}

private function parseHreflangLinks(\SimpleXMLElement $node): array

{

$links = [];

foreach ($node->children(self::XHTML_NS)->link as $link) {

$links[] = $link;

}

return collect($links)

->mapWithKeys(function (\SimpleXMLElement $link) {

$attrs = $link->attributes();

return [(string) ($attrs['hreflang'] ?? '') => trim((string) ($attrs['href'] ?? ''))];

})

->filter(fn (string $href, string $lang) => $lang !== '' && $href !== '')

->all();

}

private function validateHreflang(Collection $entries): Collection

{

$locSet = $entries->pluck('loc')->flip();

$hreflangMap = $entries

->filter(fn (array $e) => ! empty($e['hreflang']))

->pluck('hreflang', 'loc');

return $hreflangMap

->flatMap(fn (array $alternates, string $loc) => $this->checkAlternates($loc, $alternates, $locSet, $hreflangMap))

->values();

}

private function checkAlternates(string $loc, array $alternates, Collection $locSet, Collection $hreflangMap): array

{

$issues = collect($alternates)

->flatMap(fn (string $href, string $lang) => $this->checkSingleAlternate($loc, $lang, $href, $locSet, $hreflangMap))

->all();

$hasSelfRef = in_array($loc, $alternates, true);

if (! $hasSelfRef) {

$issues[] = [

'type' => 'missing_self_ref',

'loc' => $loc,

'detail' => 'Missing self-referencing hreflang annotation',

];

}

return $issues;

}

private function checkSingleAlternate(string $loc, string $lang, string $href, Collection $locSet, Collection $hreflangMap): array

{

$issues = [];

if (! $locSet->has($href)) {

$issues[] = [

'type' => 'missing_in_sitemap',

'loc' => $loc,

'detail' => "hreflang=\"{$lang}\" points to {$href} which is NOT in the sitemap",

];

return $issues;

}

if ($href === $loc) {

return $issues;

}

if (! $hreflangMap->has($href)) {

$issues[] = [

'type' => 'missing_reciprocal',

'loc' => $loc,

'detail' => "hreflang=\"{$lang}\" points to {$href}, but that page has no hreflang annotations",

];

return $issues;

}

if (! in_array($loc, $hreflangMap->get($href), true)) {

$issues[] = [

'type' => 'missing_reciprocal',

'loc' => $loc,

'detail' => "hreflang=\"{$lang}\" points to {$href}, but that page does not link back",

];

}

return $issues;

}

private function fetchPages(Collection $urls, int $timeout): Collection

{

$concurrency = max(1, (int) $this->option('concurrency'));

$bar = $this->output->createProgressBar($urls->count());

$bar->start();

$pages = $urls->chunk($concurrency)

->flatMap(function (Collection $chunk) use ($timeout, $bar) {

$chunkUrls = $chunk->values()->all();

$responses = Http::pool(fn (Pool $pool) => collect($chunkUrls)

->each(fn (string $pageUrl) => $pool->as($pageUrl)->timeout($timeout)->get($pageUrl))

);

return collect($chunkUrls)

->mapWithKeys(function (string $pageUrl) use ($responses, $bar) {

$bar->advance();

return [$pageUrl => $this->processResponse($pageUrl, $responses[$pageUrl] ?? null)];

})

->filter();

});

$bar->finish();

$this->newLine();

return $pages;

}

private function processResponse(string $url, mixed $response): ?array

{

if ($response === null || $response instanceof \Throwable) {

$this->brokenPages[$url] = $response instanceof \Throwable ? $response->getMessage() : 'No response';

return null;

}

if ($response->status() !== 200) {

$this->brokenPages[$url] = $response->status();

}

if ($response->failed()) {

return null;

}

$html = $response->body();

return [

'title' => $this->extractTitle($html),

'description' => $this->extractMetaDescription($html),

];

}

private function extractTitle(string $html): ?string

{

if (! preg_match('/<title[^>]*>(.*?)<\/title>/si', $html, $matches)) {

return null;

}

$title = trim(html_entity_decode($matches[1], ENT_QUOTES | ENT_HTML5, 'UTF-8'));

return $title !== '' ? $title : null;

}

private function extractMetaDescription(string $html): ?string

{

$patterns = [

'/<meta\s[^>]*name\s*=\s*["\']description["\']\s[^>]*content\s*=\s*["\']([^"\']*?)["\']/si',

'/<meta\s[^>]*content\s*=\s*["\']([^"\']*?)["\']\s[^>]*name\s*=\s*["\']description["\']/si',

];

foreach ($patterns as $pattern) {

if (preg_match($pattern, $html, $m)) {

$desc = trim(html_entity_decode($m[1], ENT_QUOTES | ENT_HTML5, 'UTF-8'));

return $desc !== '' ? $desc : null;

}

}

return null;

}

private function findDuplicates(Collection $pages, string $field): Collection

{

return $pages

->filter(fn (array $meta) => ($meta[$field] ?? null) !== null)

->groupBy(fn (array $meta) => $meta[$field], preserveKeys: true)

->filter(fn (Collection $group) => $group->count() > 1)

->map(fn (Collection $group) => $group->keys());

}

private function reportBrokenPages(): void

{

if ($this->brokenPages->isEmpty()) {

$this->info('All pages returned HTTP 200.');

$this->newLine();

return;

}

$this->error("Found {$this->brokenPages->count()} page(s) with non-200 HTTP status:");

$rows = $this->brokenPages->map(fn ($status, $url) => [$url, $status])->values()->all();

$this->table(['URL', 'Status'], $rows);

$this->newLine();

}

private function reportHreflangIssues(Collection $issues): void

{

if ($issues->isEmpty()) {

$this->info('All hreflang annotations are valid.');

$this->newLine();

return;

}

$labels = [

'missing_in_sitemap' => 'Alternate URL not found in sitemap',

'missing_reciprocal' => 'Missing reciprocal hreflang link',

'missing_self_ref' => 'Missing self-referencing hreflang',

];

$this->error("Found {$issues->count()} hreflang issue(s):");

$issues->groupBy('type')->each(function (Collection $group, string $type) use ($labels) {

$this->newLine();

$this->warn(' '.($labels[$type] ?? $type).':');

$group->each(function (array $issue) {

$this->line(" {$issue['loc']}");

$this->line(" {$issue['detail']}");

});

});

$this->newLine();

}

private function reportDuplicateUrls(Collection $duplicates): void

{

if ($duplicates->isEmpty()) {

$this->info('No duplicate URLs found in the sitemap.');

$this->newLine();

return;

}

$this->error("Found {$duplicates->count()} duplicate URL(s) in the sitemap:");

$rows = $duplicates->map(fn (int $count, string $url) => [$url, $count])->values()->all();

$this->table(['URL', 'Occurrences'], $rows);

$this->newLine();

}

private function reportDuplicates(Collection $duplicates, string $label): void

{

if ($duplicates->isEmpty()) {

$this->info("No duplicate <{$label}> values found.");

$this->newLine();

return;

}

$this->error("Found {$duplicates->count()} duplicate <{$label}> value(s):");

$duplicates->each(function (Collection $urls, string $value) {

$truncated = mb_strlen($value) > 80 ? mb_substr($value, 0, 80) : $value;

$this->warn(" \"{$truncated}\":");

$urls->each(fn (string $url) => $this->line(" {$url}"));

});

$this->newLine();

}

private function printSummary(

Collection $duplicateUrls,

Collection $duplicateTitles,

Collection $duplicateDescriptions,

Collection $hreflangIssues,

): void {

$this->newLine();

$this->info('Audit Summary');

$summaryLine = fn (string $label, Collection $items) => sprintf(

' %-30s %d',

$label,

$items->count(),

);

$this->line($summaryLine('Non-200 pages:', $this->brokenPages));

$this->line($summaryLine('Duplicate URLs:', $duplicateUrls));

$this->line($summaryLine('Hreflang issues:', $hreflangIssues));

$this->line($summaryLine('Duplicate title:', $duplicateTitles));

$this->line($summaryLine('Duplicate meta description:', $duplicateDescriptions));

}

}